- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:44.

- Naposledy změněno 2025-01-22 17:20.

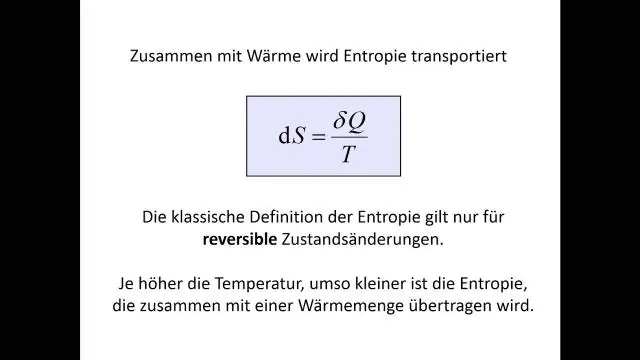

Entropie : A rozhodovací strom je sestaven shora dolů z kořenového uzlu a zahrnuje rozdělení dat do podmnožin, které obsahují instance s podobnými hodnotami (homogenní). Používá algoritmus ID3 entropie pro výpočet homogenity vzorku.

Lidé se také ptají, jaká je definice entropie ve strojovém učení?

Entropie , jak se to týká strojové učení , je mírou náhodnosti ve zpracovávaných informacích. Čím vyšší entropie , tím těžší je z těchto informací vyvozovat nějaké závěry. Hození mincí je příkladem akce, která poskytuje informace, které jsou náhodné. Toto je podstata entropie.

Co je kromě výše uvedeného informační zisk a entropie v rozhodovacím stromě? The informační zisk je založen na poklesu v entropie po rozdělení datové sady na atribut. Stavba a rozhodovací strom je o nalezení atributu, který vrátí nejvyšší hodnotu informační zisk (tj. nejvíce homogenní větve). Výsledkem je Zisk informací nebo snížit entropie.

Víte také, jaká je minimální hodnota entropie v rozhodovacím stromě?

Entropie je Nejnižší v extrémech, kdy bublina buď neobsahuje žádné pozitivní instance, nebo pouze pozitivní instance. To znamená, že když je bublina čistá, porucha je 0. Entropie je nejvyšší uprostřed, když je bublina rovnoměrně rozdělena mezi kladné a záporné instance.

Co je to entropie v náhodném lese?

Co je Entropie a proč na získávání informací záleží Rozhodnutí stromy? Násir Islam Sujan. 29. června 2018 · 5 min čtení. Podle Wikipedie, Entropie odkazuje na poruchu nebo nejistotu. Definice: Entropie je míra nečistoty, nepořádku nebo nejistoty ve spoustě příkladů.

Doporučuje:

Jaká je nejlepší definice bezpečnostního modelu?

Bezpečnostní model je technické hodnocení každé části počítačového systému za účelem posouzení její shody s bezpečnostními standardy. D. Bezpečnostní model je proces formálního přijetí certifikované konfigurace

Jaká je definice kvalitativních a kvantitativních pozorování?

Zahrnuje pozorování čehokoli, co lze měřit, jako jsou rozdíly ve tvarech, velikostech, barvě, objemu a číslech. Kvalitativní pozorování je subjektivní proces shromažďování dat nebo informací, zatímco kvantitativní pozorování je objektivní proces shromažďování dat nebo informací

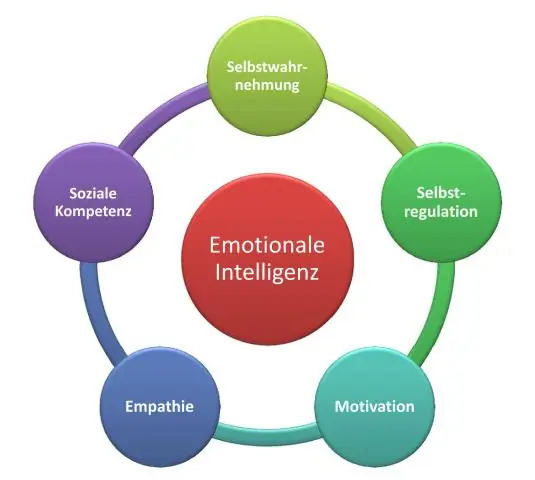

Jaká je definice inteligence v psychologii?

Inteligence je schopnost myslet, učit se ze zkušenosti, řešit problémy a přizpůsobovat se novým situacím. Psychologové se domnívají, že existuje konstrukt, známý jako obecná inteligence (g), který odpovídá za celkové rozdíly v inteligenci mezi lidmi

Jaká je definice lineárního blokového kódu?

'Lineární blokový kód je blokový kód, ve kterém výhradní nebo libovolné dvě kódová slova vede k jinému kódovému slovu

Co je to uzel v rozhodovacím stromu?

Rozhodovací strom je struktura podobná vývojovému diagramu, ve které každý vnitřní uzel představuje „test“atributu (např. zda se hod mincí objeví po hlavě nebo po patě), každá větev představuje výsledek testu a každý listový uzel představuje označení třídy (rozhodnutí přijato po výpočtu všech atributů)